الحل السحري لمدققي المعلومات في كشف صور الذكاء الاصطناعي.

أسامينا

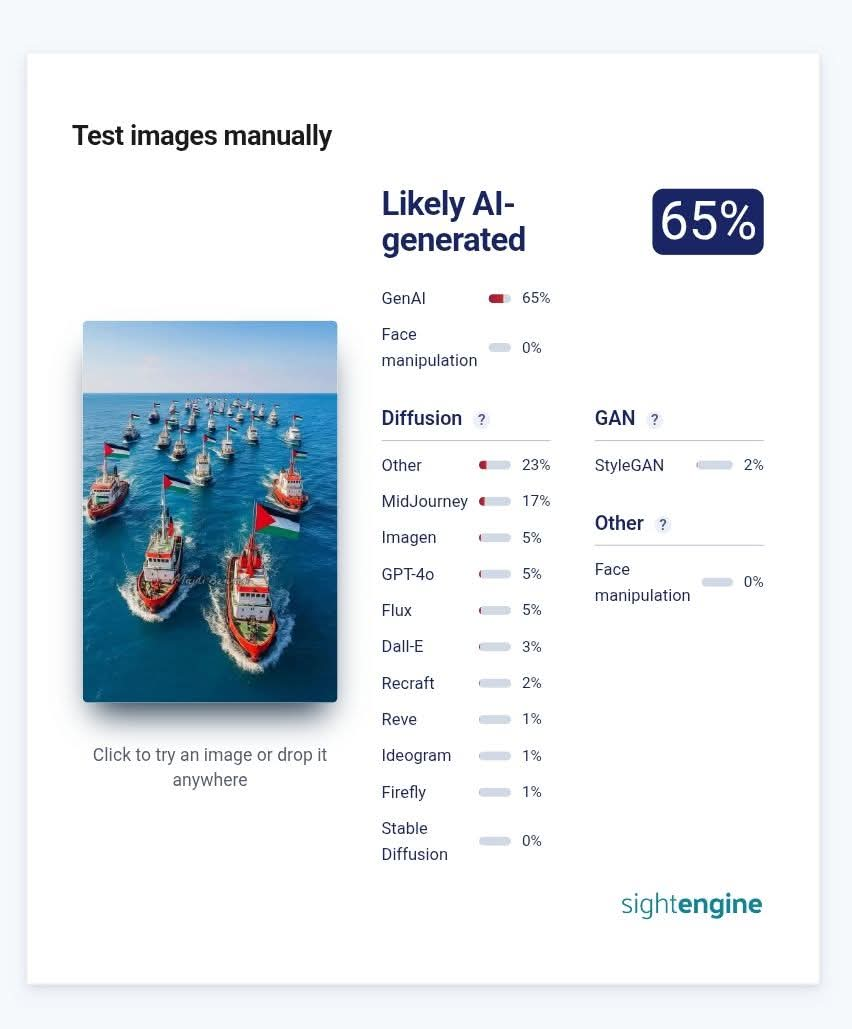

في الفترة الأخيرة، ومع التطور الكبير في أدوات الذكاء الاصطناعي، أصبح من الصعب التفرقة بين الصورة الحقيقية والصورة المصنوعة. كثير من الصور المولدة اليوم تكاد تكون مطابقة للواقع، الأمر الذي يجعل الاعتماد على النظر وحده أو حتى الخبرة الصحفية التقليدية غير كافٍ. هنا يظهر دور أدوات متقدمة مثل Hive Moderation التي تُعد واحدة من أبرز الحلول التقنية في مجال كشف الصور المولدة بالذكاء الاصطناعي.

تعتمد Hive Moderation على نماذج تعلم عميق تم تدريبها على ملايين الصور، سواء كانت حقيقية أو مولدة عبر خوارزميات مثل الشبكات التوليدية التنافسية ونماذج الانتشار. هذه النماذج لا تكتفي بتحليل الصورة بشكل سطحي، بل تبني ما يُعرف بالبصمة البصرية، وهي أنماط دقيقة جدًا لا يراها الإنسان، لكنها تكشف عن مصدر الصورة وما إذا كانت طبيعية أم مصنوعة. عند رفع أي صورة على المنصة، تبدأ الأداة في تحليلها وتقدّم تقريرًا يتضمن نسبة مئوية توضّح احتمالية أن تكون الصورة مولدة بالذكاء الاصطناعي، إلى جانب مؤشرات إضافية إذا كان هناك تعديل موضعي أو تركيب لعناصر معينة.

أهمية الأداة تكمن في سرعتها ومرونتها. فهي قادرة على تقديم نتيجة خلال ثوانٍ معدودة، وهو ما يجعلها مفيدة للغاية في بيئات العمل الصحفي التي تتطلب قرارات سريعة، وكذلك في التحقيقات الرقمية التي تحتاج إلى دقة عالية. الأداة أيضًا ليست محصورة في الاستخدام الفردي، بل يمكن دمجها عبر واجهات برمجية مباشرة داخل غرف الأخبار أو أنظمة إدارة المحتوى، مما يجعلها جزءًا من منظومة التحقق اليومية.

Hive

لا يمكن اعتبار Hive Moderation مجرد أداة مساعدة، بل هي جزء من البنية التحتية الضرورية لحماية المصداقية. فهي تمنح الصحفي أو الباحث أو المحقق الرقمي مستوى أعلى من الثقة في التعامل مع الأدلة البصرية، وتساعد على الحد من مخاطر تمرير المحتوى المزور دون تدقيق.